说明文档

license: creativeml-openrail-m tags:

- stable-diffusion

- stable-diffusion-diffusers

- text-to-image inference: true

本仓库包含最初由 RunwayML 发布、随后被下架的模型,但已转换为 ONNX 格式。原始许可证允许重新上传模型,只要未将其修改用于有害用途。该模型本身除转换为 ONNX 外未作任何修改。

Stable Diffusion v1-5 模型卡

Stable Diffusion 是一种潜在文本到图像扩散模型,能够根据任意文本输入生成逼真的图像。 有关 Stable Diffusion 工作原理的更多信息,请参阅 🤗 的 Stable Diffusion 博客。

Stable-Diffusion-v1-5 检查点使用 Stable-Diffusion-v1-2 检查点的权重进行初始化,随后在 512x512 分辨率下基于 "laion-aesthetics v2 5+" 数据集进行了 595k 步的微调,并以 10% 的概率丢弃文本条件,以改进无分类器引导采样。

您可以同时使用 🧨Diffusers 库 和 RunwayML GitHub 仓库 来使用此模型。

模型详情

-

开发者: Robin Rombach, Patrick Esser

-

模型类型: 基于扩散的文本到图像生成模型

-

语言: 英语

-

许可证: CreativeML OpenRAIL M 许可证 是一种 Open RAIL M 许可证,改编自 BigScience 和 RAIL 倡议 在负责任 AI 许可领域共同开展的工作。另请参阅我们许可证所基于的关于 BLOOM Open RAIL 许可证的文章。

-

模型描述: 这是一个可用于根据文本提示生成和修改图像的模型。它是一种潜在扩散模型,使用固定的预训练文本编码器(CLIP ViT-L/14),如 Imagen 论文所建议。

-

引用为:

@InProceedings{Rombach_2022_CVPR, author = {Rombach, Robin and Blattmann, Andreas and Lorenz, Dominik and Esser, Patrick and Ommer, Bj\\"orn}, title = {High-Resolution Image Synthesis With Latent Diffusion Models}, booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)}, month = {June}, year = {2022}, pages = {10684-10695} }

用途

直接使用

该模型仅用于研究目的。可能的研究领域和任务包括

- 安全部署可能生成有害内容的模型。

- 探索和理解生成式模型的局限性和偏见。

- 艺术作品生成以及在设计和其他艺术过程中的应用。

- 教育或创意工具中的应用。

- 关于生成式模型的研究。

排除的用途如下所述。

滥用、恶意使用和超范围使用

注:本节摘自 DALLE-MINI 模型卡,但同样适用于 Stable Diffusion v1。

该模型不应用于故意创建或传播为人们制造敌对或疏离环境的图像。这包括生成人们可能预见到会感到不安、痛苦或冒犯的图像;或传播历史或当前刻板印象的内容。

超范围使用

该模型未经过训练以生成人物或事件的真实或事实性呈现,因此使用该模型生成此类内容超出了该模型的能力范围。

滥用和恶意使用

使用该模型生成对个人残忍的内容是对该模型的滥用。这包括但不限于:

- 生成对人们或其环境、文化、宗教等有贬低、非人化或其他有害的呈现。

- 故意宣扬或传播歧视性内容或有害刻板印象。

- 未经同意冒充个人。

- 未经可能看到的人同意的性内容。

- 虚假信息和错误信息

- 极端暴力和血腥的呈现

- 违反使用条款分享受版权保护或授权的材料。

- 违反使用条款分享受版权保护或授权材料的修改版本。

局限性和偏见

局限性

- 该模型无法实现完美的逼真度

- 该模型无法渲染清晰的文本

- 该模型在涉及组合性的较难任务上表现不佳,例如渲染与"蓝色球体上的红色立方体"对应的图像

- 面部和人物整体可能无法正确生成。

- 该模型主要使用英文说明进行训练,在其他语言中效果不佳。

- 模型的自编码部分是有损的

- 该模型在大规模数据集 LAION-5B 上训练,其中包含成人内容,在没有额外安全机制和考虑的情况下不适合产品使用。

- 没有使用额外措施对数据集进行去重。因此,我们观察到训练数据中重复的图像存在一定程度的记忆现象。 训练数据可在 https://rom1504.github.io/clip-retrieval/ 搜索,可能有助于检测记忆的图像。

偏见

虽然图像生成模型的能力令人印象深刻,但它们也可能强化或加剧社会偏见。 Stable Diffusion v1 在 LAION-2B(en) 的子集上训练, 其中主要由英文描述的图像组成。 使用其他语言的社区和文化的文本和图像可能未被充分涵盖。 这影响了模型的整体输出,因为白人和西方文化通常被设为默认值。此外, 该模型使用非英文提示生成内容的能力明显不如使用英文提示。

安全模块

该模型的预期用途是与 Diffusers 中的安全检查器一起使用。

该检查器通过将模型输出与已知的硬编码 NSFW 概念进行检查来工作。

这些概念被有意隐藏,以降低此过滤器被逆向工程的可能性。

具体而言,检查器在图像生成之后,在 CLIPTextModel 的嵌入空间中比较有害概念的类概率。

这些概念与生成的图像一起传递到模型中,并与每个 NSFW 概念的手工工程权重进行比较。

训练

训练数据 模型开发者使用以下数据集来训练模型:

- LAION-2B (en) 及其子集(见下一节)

训练过程 Stable Diffusion v1-5 是一种潜在扩散模型,它将自编码器与在自编码器潜在空间中训练的扩散模型相结合。在训练期间,

- 图像通过编码器编码,将图像转换为潜在表示。自编码器使用 8 的相对下采样因子,将形状为 H x W x 3 的图像映射为形状为 H/f x W/f x 4 的潜在表示

- 文本提示通过 ViT-L/14 文本编码器编码。

- 文本编码器的非池化输出通过交叉注意力输入到潜在扩散模型的 UNet 主干。

- 损失是添加到潜在表示中的噪声与 UNet 所做预测之间的重建目标。

目前提供六个 Stable Diffusion 检查点,其训练方式如下。

-

stable-diffusion-v1-1:在 laion2B-en 上以256x256分辨率训练 237,000 步。 在 laion-high-resolution(来自 LAION-5B 的 170M 个分辨率>= 1024x1024的示例)上以512x512分辨率训练 194,000 步。 -

stable-diffusion-v1-2:从stable-diffusion-v1-1恢复。 在 "laion-improved-aesthetics"(laion2B-en 的一个子集, 筛选为原始大小>= 512x512、估计美学分数> 5.0、估计水印概率< 0.5的图像。水印估计来自 LAION-5B 元数据,美学分数使用改进的美学估计器估计)上以512x512分辨率训练 515,000 步。 -

stable-diffusion-v1-3:从stable-diffusion-v1-2恢复 - 在 "laion-improved-aesthetics" 上以512x512分辨率训练 195,000 步,并以 10% 的概率丢弃文本条件以改进无分类器引导采样。 -

stable-diffusion-v1-4从stable-diffusion-v1-2恢复 - 在 "laion-aesthetics v2 5+" 上以512x512分辨率训练 225,000 步,并以 10% 的概率丢弃文本条件以改进无分类器引导采样。 -

stable-diffusion-v1-5从stable-diffusion-v1-2恢复 - 在 "laion-aesthetics v2 5+" 上以512x512分辨率训练 595,000 步,并以 10% 的概率丢弃文本条件以改进无分类器引导采样。 -

stable-diffusion-inpainting从stable-diffusion-v1-5恢复 - 然后在 "laion-aesthetics v2 5+" 上以 512x512 分辨率进行 440,000 步的图像修复训练,并以 10% 的概率丢弃文本条件。对于图像修复,UNet 有 5 个额外的输入通道(4 个用于编码的掩码图像,1 个用于掩码本身),其权重在恢复非修复检查点后进行零初始化。在训练期间,我们生成合成掩码,并在 25% 的情况下掩码所有内容。 -

硬件: 32 x 8 x A100 GPU

-

优化器: AdamW

-

梯度累积: 2

-

批次大小: 32 x 8 x 2 x 4 = 2048

-

学习率: 预热 10,000 步至 0.0001,然后保持恒定

评估结果

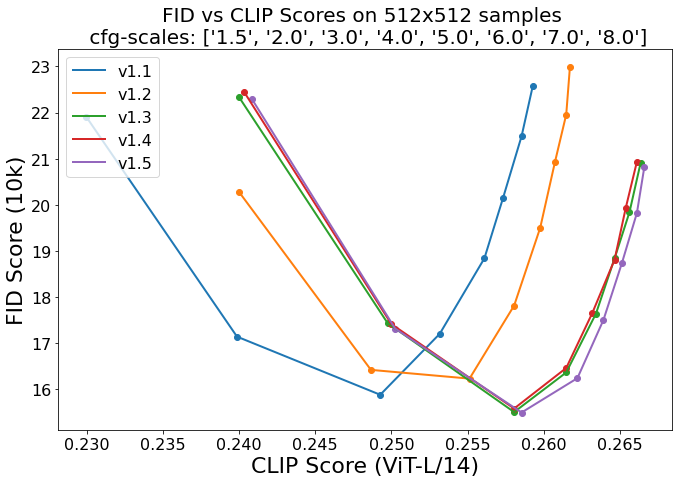

使用不同无分类器引导比例(1.5、2.0、3.0、4.0、5.0、6.0、7.0、8.0)和 50 PNDM/PLMS 采样步骤的评估显示了检查点的相对改进:

使用 50 PLMS 步骤和来自 COCO2017 验证集的 10000 个随机提示进行评估,在 512x512 分辨率下评估。未针对 FID 分数进行优化。

环境影响

Stable Diffusion v1 估计排放量 基于该信息,我们使用 Lacoste et al. (2019) 中提出的机器学习影响计算器估计以下 CO2 排放量。硬件、运行时间、云提供商和计算区域被用于估计碳影响。

- 硬件类型: A100 PCIe 40GB

- 使用小时数: 150000

- 云提供商: AWS

- 计算区域: 美国东部

- 碳排放量(功耗 x 时间 x 基于电网位置的碳产生量): 11250 kg CO2 eq.

引用

@InProceedings{Rombach_2022_CVPR,

author = {Rombach, Robin and Blattmann, Andreas and Lorenz, Dominik and Esser, Patrick and Ommer, Bj\\"orn},

title = {High-Resolution Image Synthesis With Latent Diffusion Models},

booktitle = {Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)},

month = {June},

year = {2022},

pages = {10684-10695}

}

本模型卡由以下人员编写:Robin Rombach 和 Patrick Esser,基于 DALL-E Mini 模型卡。

modularai/stable-diffusion-1.5-onnx

作者 modularai

创建时间: 2024-09-03 17:35:20+00:00

更新时间: 2024-09-03 17:37:51+00:00

在 Hugging Face 上查看